설명 가능한 AI가 한 단계 현실로 왔다

- 이번 연구의 핵심은 설명 규칙을 묶어 더 많은 입력을 잡아내는 방식으로 재현율을 크게 끌어올렸다는 점입니다.

- 논문 기준으로 재현율은 크게 개선됐지만 비용이 완전히 없는 것은 아니며, 규칙 길이가 늘어나는 식의 맞바꿈은 남아 있습니다.

- 당장 일반 사용자가 바로 쓰는 도구는 아니지만, 설명 가능한 AI를 실제 서비스에 붙이려는 팀이라면 방향성을 체크할 만한 업데이트입니다.

한마디로 정리하면, 이 연구는 설명 가능한 AI가 놓치던 사례를 더 많이 포착하도록 규칙을 묶는 방법을 제안합니다. 특히 모델이 왜 그런 판단을 했는지 설명해야 하는 환경에서 의미가 크고, 지금 바로 제품에 넣기보다는 연구와 검증 단계에서 먼저 볼 만한 변화입니다. 현재 확인된 범위는 논문과 비교 벤치마크 중심이며, 상용 서비스 적용 성과까지 확인된 상태는 아닙니다.

무엇이 나왔나: 설명 규칙을 묶어서 놓치던 입력을 더 잡는 방식

이번 연구를 쉽게 풀어 말하면, 기존 방식이 하나씩 따로 설명하던 규칙들을 함께 묶어서 더 넓은 범위의 입력을 설명 안으로 끌어들이는 방법입니다. 논문에서 제안한 EFGA는 기존 FGA에서 뽑아낸 규칙들을 결합하는데, 이때 핵심은 규칙을 단순히 많이 붙이는 것이 아니라 서로 다른 전제 조건을 합쳐서 포착 범위를 넓힌다는 점입니다. 연구진은 이런 구조 덕분에 규칙 집합을 만족하는 입력 수가 늘어나는 방향으로 갈 수 있다고 설명합니다.

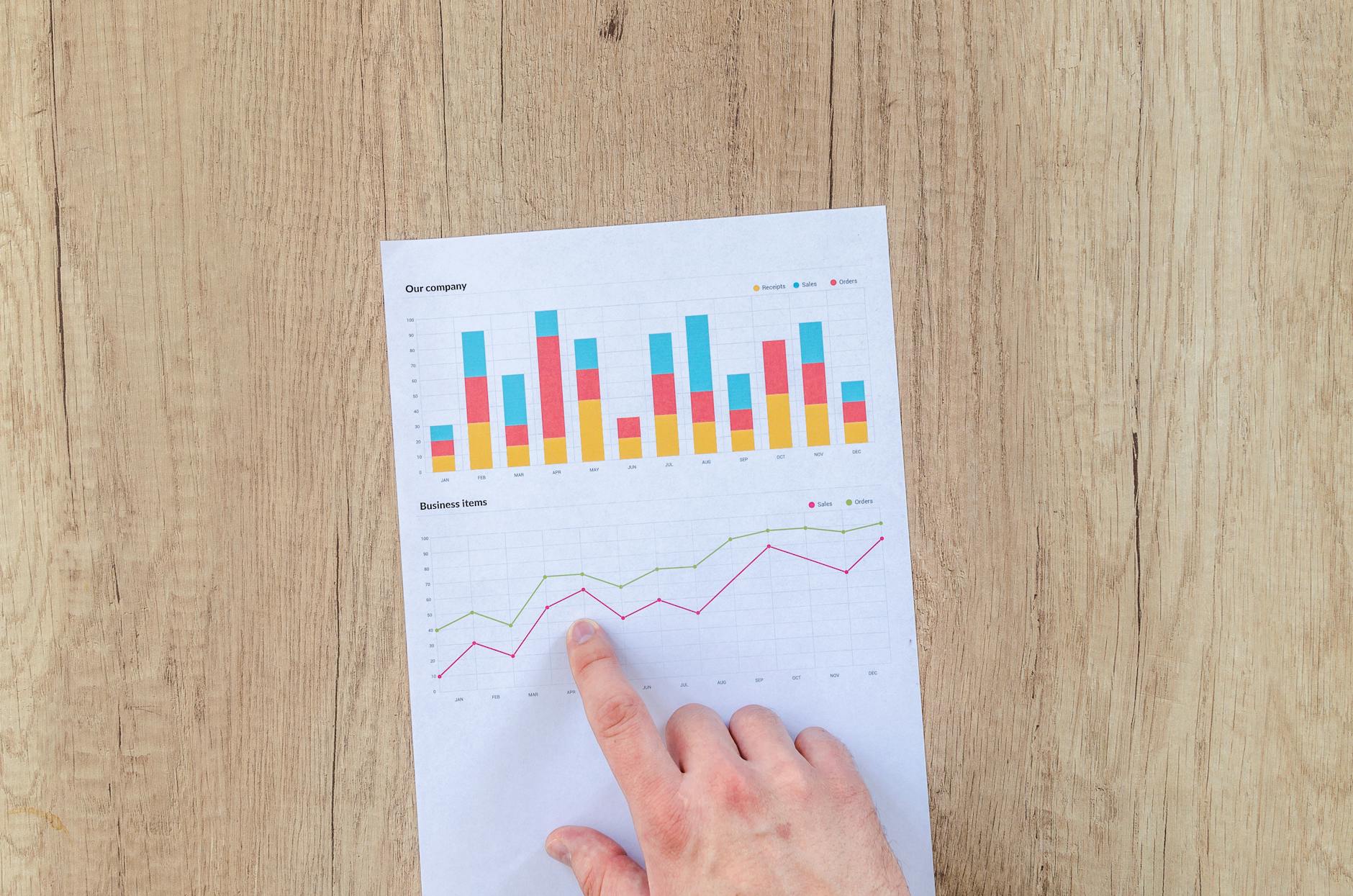

숫자도 꽤 눈에 띕니다. 논문 기준으로 EFGA는 기존 FGA 대비 학습 재현율을 MNIST에서 28.51퍼센트, LSC에서 33.15퍼센트 높였고, 테스트 재현율도 각각 25.76퍼센트와 30.81퍼센트 개선됐다고 제시합니다.

반면 테스트 정밀도 하락은 MNIST에서 0.89퍼센트, LSC에서 0.69퍼센트로 비교적 작게 나타났습니다. 여기서 중요한 포인트는 단순히 성능이 좋아졌다는 말이 아니라, 놓치는 사례를 크게 줄이면서도 정밀도 손실을 작게 억제하려 했다는 데 있습니다.

왜 이게 설명 가능한 AI에서 중요할까요. 설명 모델은 보통 잘 맞는 사례를 예쁘게 설명하는 데 그치면 실제 활용성이 낮아질 수 있습니다.

예를 들어 모델이 특정 결정을 왜 내렸는지 규칙으로 보여주더라도, 정작 많은 입력을 커버하지 못하면 품질 점검이나 감사 용도로 쓰기 어렵습니다. 그래서 재현율은 단순한 보조 지표가 아니라, 설명이 실제로 얼마나 넓게 적용되는지를 보여주는 핵심 기준이 됩니다.

이번 연구는 바로 이 부분을 찌른 셈입니다.

다만 여기서 오해하면 안 되는 부분도 있습니다. 재현율이 올랐다고 해서 모든 문제가 해결된 것은 아닙니다. 연구 번들에 포함된 충돌 메모처럼, 정밀도와 복잡도 사이의 맞바꿈은 여전히 남아 있습니다. 논문을 좋게 읽더라도 공짜 개선이라고 말하면 과장입니다. 즉, 더 많이 잡아내는 대신 규칙이 길어지거나 구조가 복잡해질 수 있고, 실제 운영 환경에서는 이 복잡도가 비용으로 돌아올 수 있습니다.

검증 강도 공식/확인 중심. 공식 발표와 반복 관측 루머를 같은 무게로 읽지 않는 편이 안전합니다.

누가 바로 체감하나: 설명이 중요하지만 놓침이 치명적인 팀

이 연구를 가장 먼저 주목해야 하는 사람은 일반 소비자보다 설명 가능한 AI를 품질 관리나 검증 흐름에 연결하려는 팀입니다. 예를 들어 모델의 판단 이유를 문서로 남겨야 하거나, 결과를 나중에 다시 점검해야 하거나, 특정 입력을 놓치면 위험이 커지는 환경이라면 EFGA 같은 접근이 꽤 실용적인 힌트를 줄 수 있습니다. 설명이 있어야 하는데 설명 범위가 좁아 답답했던 팀이라면 특히 더 그렇습니다.

연구자에게는 이 논문이 방향성 신호로 읽힐 가능성이 큽니다. 기존 설명 규칙을 그냥 정교하게 다듬는 대신, 여러 규칙을 묶는 식으로 커버리지를 넓히는 전략이 먹힌다는 점을 수치로 보여줬기 때문입니다. 실무자 입장에서도 의미가 있습니다. 지금 당장 이 논문을 가져다 서비스에 붙이기보다, 내부 평가 도구나 모델 분석 파이프라인에서 설명 범위를 넓히는 보조 레이어로 검토해볼 수 있습니다.

특히 놓침이 민감한 분야에서는 이런 흐름이 더 중요합니다. 보안 이상 탐지, 의료 보조 판단, 중요 문서 분류처럼 일부 사례를 놓치는 것이 문제로 이어질 수 있는 작업에서는, 정확도만 높은 시스템보다 커버 범위를 넓게 가져가는 시스템이 더 유리할 때가 있습니다. 물론 이 논문이 이런 분야에서 바로 검증됐다는 뜻은 아닙니다. 다만 설명 가능성과 포착 범위를 동시에 챙기려는 흐름이 점점 현실적인 과제로 올라오고 있다는 점은 분명히 보여줍니다.

반대로 일반 독자 입장에서는 체감이 느릴 수 있습니다. 스마트폰 앱 업데이트처럼 오늘 바로 써볼 기능은 아니기 때문입니다.

하지만 앞으로 우리가 쓰게 될 AI 서비스가 더 자주 설명을 달고, 그 설명이 더 넓은 사례를 덮기 시작한다면, 이런 연구들이 밑바탕 역할을 하게 됩니다. 그래서 지금 단계에서는 직접 사용 소식이라기보다, 다음 세대 신뢰형 AI가 어떤 방향으로 움직이는지 보는 연구 뉴스로 이해하는 편이 맞습니다.

AI 뉴스는 챙겨보지만 논문 원문까지 읽지는 않는 일반 독자, 또는 모델 성능보다 실제 설명 가능성과 안전성까지 궁금한 실무 초중급 독자가 바로 체감할 변화인지, 아니면 특정 사용자만 체감하는 변화인지 나눠 보는 편이 좋습니다.

원문 확인 링크

핵심 판단을 바꾸는 원문만 추려서 바로 확인할 수 있게 묶었습니다.

놓치기 쉬운 제약

좋아진 숫자만 보면 만능처럼 보일 수 있지만, 이 연구도 재현율을 올리는 대신 규칙이 길어지거나 복잡도가 늘어날 수 있다는 한계를 함께 봐야 합니다. 즉, 잘 잡아내는 힘은 강해졌지만 공짜 개선은 아닙니다.

바로 적용 가능한 범위와 아직 남아 있는 제한 조건을 따로 적어 두면 과한 기대를 줄일 수 있습니다.

반례와 예외를 따로 적어 두면 headline 한 줄로 과하게 결론내리는 실수를 줄일 수 있습니다.

지금 써볼지 말지 판단 기준

지금 당장 필요한 판단 기준은 분명합니다. 설명 가능한 AI의 빈틈을 줄이는 연구 흐름을 추적하는 독자라면 바로 읽어볼 가치가 있고, 일반 사용자라면 당장 체감 기능보다 앞으로 어떤 서비스 품질 변화로 이어질지 관찰하는 정도가 적절합니다.

지금 확인할 3가지

- 공식 발표에서 실제로 바뀐 범위를 다시 확인하기

- 28.51% 같은 핵심 숫자가 체감 변화로 이어지는지 보기

- 다음 업데이트에서 제한 조건이 바뀌는지 확인하기

확인한 범위와 출처

확인 시점(날짜/시간): 2026-03-23 20:34 KST

확인 범위(무엇을 확인했는가): 논문 원문 기준 EFGA의 핵심 구조와 정의,MNIST와 LSC에서 제시된 재현율 및 정밀도 변화 수치,앙상블 방식의 일반적 배경 설명과 비교용 벤치마크 맥락,특성 선택과 과적합 위험에 대한 일반 배경

미확정 항목(무엇이 아직 불확실한가):

- EFGA의 상용 서비스 실제 도입 사례

- 실시간 운영 환경에서의 비용 효율성

- 자율주행 등 특정 산업 현장 적용 성능

- 정밀도 손실이 모든 데이터셋에서 비슷하게 유지된다는 일반화

Share or react

Leave a reaction, share this article, or join the discussion below.

Reader response

What landed?

Leave a quick reaction without interrupting the reading flow.

Discussion

Reader notes

Add context, disagreement, or a useful follow-up for the next reader.